近期,一位來自OpenAI的前員工公開預警,超級智能技術的進步速度遠超人們的想象,並會給人類社會帶來巨大的動蕩和挑戰:超級智能幾周的學習與進化,可能相當於人類文明幾十億年的積澱。

據「每日經濟新聞」,2024年4月,前OpenAI超級對齊部門成員、利奧波德·阿申布倫納(Leopold Aschenbrenner)被OpenAI以洩露公司機密為由解雇。6月初,阿申布倫納在網站上發佈了一份長達165頁的PDF文件,文件匯總了他在OpenAI工作期間所瞭解的信息,深入探討了當前AI技術的進展、從人工通用智能(AGI)到超級智能(Superintelligence)的發展路徑等問題。

阿申布倫納發佈的PDF文件《態勢感知》。X截圖

6月初,利奧波德·阿申布倫納在博客節目Dwarkesh Podcast中,透露他被開除的真實原因——他給幾位董事會成員分享了一份OpenAI安全備忘錄,結果導致OpenAI管理層不滿。同日,阿申布倫納在社交平台上,發佈了一份長達165頁的PDF文檔。

阿申布倫納X截圖

阿申布倫納將他的這份文件命名為《態勢感知》(Situational Awareness)。在文件的開頭,他特別指出,雖然自己曾在OpenAI工作,但自己的預測都是基於公開信息、自己的想法、工作期間的八卦等。他還在這份文件的開頭特別緻敬了前OpenAI首席科學家伊爾亞·蘇茨克維(Ilya Sutskever)和其他OpenAI超級對齊團隊的成員。

他認為目前全世界只有僅僅幾百人對AI的發展有真正意義上的感知,這些人大多集中在舊金山地區以及全球各地的AI實驗室里,自己便是這幾百人中的一員。而那些主流評論家們只看到了炒作和常規的商業模式,他們認為這不過是另一場互聯網規模的技術變革。

阿申布倫納在《態勢感知》開頭致敬前OpenAI首席科學家伊爾亞·蘇茨克維。

阿申布倫納在文章中指出,AI的進步不會止步於人類水平。例如,在最初學習了人類最好的棋局之後,AlphaGo開始與自己對弈,它很快實現了超越人類的水平,下出了人類永遠無法想出的極具創意和複雜性的棋步。

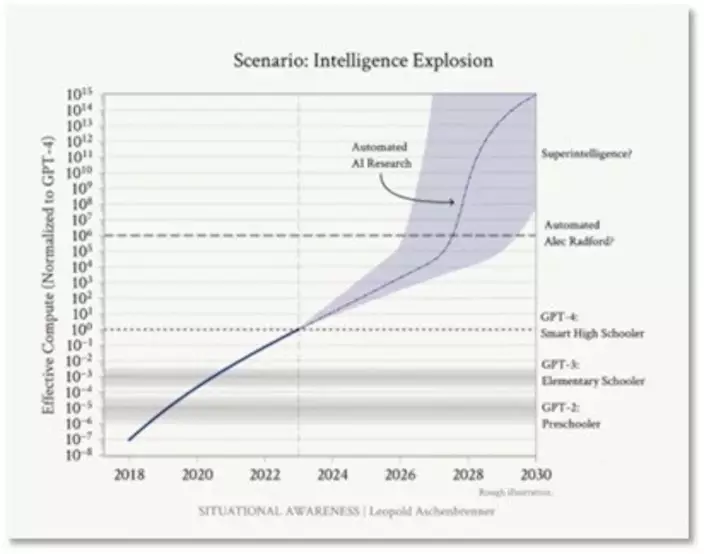

在實現AGI後,人類將能夠利用先進的AGI系統實現自動化的AI研究,將十年的算法進步壓縮到一年內。這意味著我們將迅速從人類水平的AI系統過渡到遠超人類的超級智能系統。這可能會將人類10年的算法進展壓縮到不到1年的時間里。與現有領先的AI實驗室的數百名研究人員和工程師相比,未來的AI實驗室可能會擁有成千上萬個AGI系統,夜以繼日地努力實現算法突破,不斷自我完善,加速算法進步的現有趨勢。

《態勢感知》內文截圖

他寫道:「超級智能的力量和危險將是戲劇性的。」這種轉變不僅會帶來技術上的飛躍,還將引發一系列倫理和安全問題。

阿申布倫納強調,通過一些新的創新,超級智能在幾周內就能獲得相當於人類數十億年的經驗。這種前所未有的學習速度將使超級智能在數量和質量上遠超人類。他指出:「這些AI系統將能夠以我們無法想象的速度進行思考和學習。」

阿申布倫納預測,到本世紀末,我們將擁有數以億計的超級智能,這些智能體將在數量和質量上遠超人類。他寫道:「在數以億計的GPU上運行的超級智能,將能夠比人類快幾個數量級地『思考』。」這種超級智能的湧現將帶來巨大的技術進步,但也伴隨著巨大的風險。

《態勢感知》內文截圖

文章中最引人注目的觀點之一是,十億超級智能將能夠將人類研究人員在下個世紀進行的研發工作壓縮到幾年內。這種壓縮效應將極大地加速技術進步,但也可能帶來難以預見的後果。

阿申布倫納指出:「超級智能將是人類有史以來最強大的技術——也是最強大的武器。它將賦予軍事上決定性的優勢,或許只有核武器可以相比。」

阿申布倫納強調,智能爆炸和其直接後果將帶來人類歷史上最為動蕩和緊張的局面。他指出:「在這個初期階段,人類的任務將不是製造酷炫的產品,而是要盡一切可能度過這一時期。」他呼籲建立一個能夠嚴肅對待這些困難抉擇的指揮鏈,以穩定國際局勢並管理智能爆炸期間的風險。

他進一步提到,儘管對齊技術可能會被濫用,但我們仍需要更好的對齊技術來確保未來模型的基本限制,如遵循指令或遵守法律。這些技術不僅僅是為了防止濫用,更是為了確保AI能夠在安全的框架內運行。

展望未來,阿申布倫納認為,我們正處於一個前所未有的快速發展時期,預計在未來四年內,計算能力將再提升約10萬倍,帶來類似於GPT-2到GPT-4的質的飛躍。他指出,這不僅意味著更好的聊天機器人,更意味著從工具到代理的轉變,從一個簡單的工具到一個更像是遠程助手的存在。

深喉

** 博客文章文責自負,不代表本公司立場 **